刷题刷出新高度,偷偷领先!偷偷领先!偷偷领先! 关注我们,悄悄成为最优秀的自己!

说说你了解的 CDC

答案:

分析&回答

什么是 CDC

CDC,Change Data Capture,变更数据获取的简称,使用CDC我们可以从数据库中获取已提交的更改并将这些更改发送到下游,供下游使用。这些变更可以包括INSERT,DELETE,UPDATE等。用户可以在以下的场景下使用CDC:

- 使用flink sql进行数据同步,可以将数据从一个数据同步到其他的地方,比如mysql、elasticsearch等。

- 可以在源数据库上实时的物化一个聚合视图

- 因为只是增量同步,所以可以实时的低延迟的同步数据

- 使用EventTime join 一个temporal表以便可以获取准确的结果

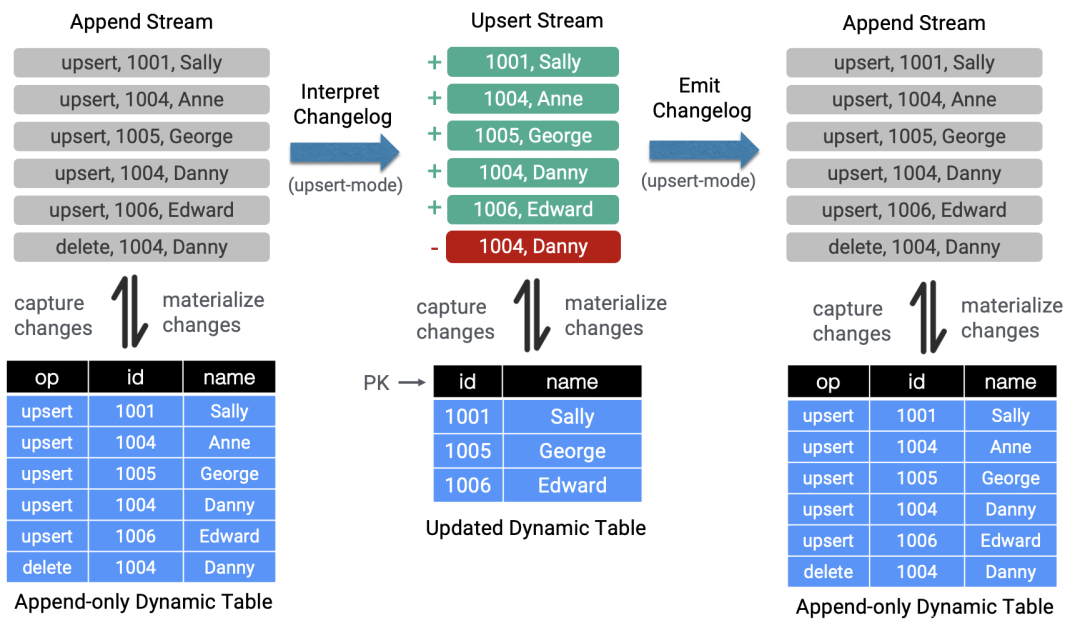

Flink 1.11 将这些changelog提取并转化为Table API和SQL,目前支持两种格式:Debezium和Canal,这就意味着源表不仅仅是append操作,而且还有upsert、delete操作。

Flink CDC 功能适用的一些场景:

- 数据库之间的增量数据同步

- 审计日志

- 数据库之上的实时物化视图

- 基于CDC的维表join

- …

Flink CDC使用方式

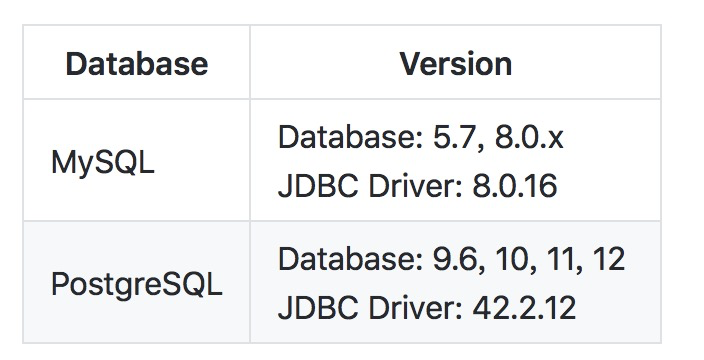

目前Flink支持两种内置的connector,PostgreSQL和mysql,接下来我们以mysql为例。

Flink 1.11仅支持Kafka作为现成的变更日志源和JSON编码的变更日志,而Avro(Debezium)和Protobuf(Canal)计划在将来的版本中使用。还计划支持MySQL二进制日志和Kafka压缩主题作为源,并将扩展日志支持扩展到批处理执行。

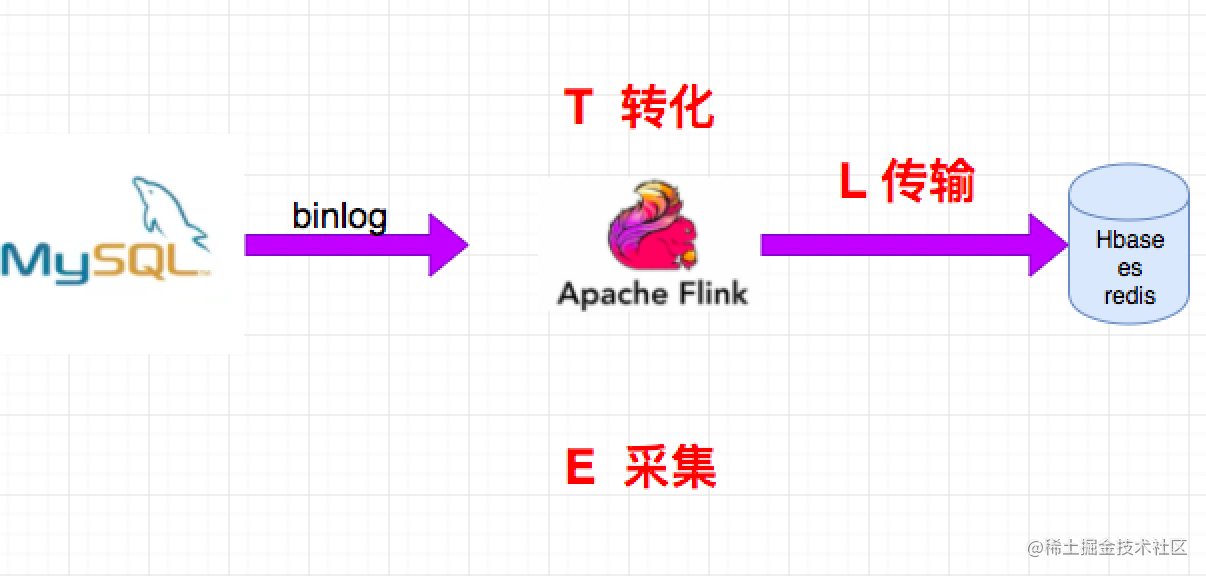

Flink CDC当作监听器获取增量变更

传统的实时链路如何实现业务数据的同步,我们以canal为例,传统业务数据实时同步会涉及到canal处理mysql的binlog然后同步到kafka,在通过计算引擎spark,flink或storm计算转化,再结果数据传输到第三方存储(hbase,es)如下图所示主要分为三个模块E(Extract) ,T(Transform), L(Load).可以看到涉及的组件很多,链路很长。我们可以直接Flink CDC消费数据库的增量日志,替代了原来作为数据采集层的canal,然后直接进行计算,经过计算之后,将计算结果 发送到下游。整体架构如下:

使用这种架构是好处有:

- 减少canal和kafka的维护成本,链路更短,延迟更低

- flink提供了exactly once语义

- 可以从指定position读取

- 去掉了kafka,减少了消息的存储成本

反思&扩展

本文链接:说说你了解的 CDC

版权声明:本站点所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明文章出处。让学习像火箭一样快速,微信扫码,获取考试解析、体验刷题服务,开启你的学习加速器!